Мне страшно. Очень напуган.

Наблюдение и цензура по всему Интернету, обеспечиваемые невообразимо огромной вычислительной мощью искусственного интеллекта (ИИ), уже здесь.

Это не футуристическая антиутопия. Это происходит сейчас.

Правительственные учреждения работают с университетами и некоммерческими организациями над использованием инструментов искусственного интеллекта для наблюдения и цензуры контента в Интернете.

Это не политика и не партийность. Речь не идет о каком-то конкретном мнении или идее.

Происходит то, что инструмент, достаточно мощный для наблюдения за всем, что говорится и делается в Интернете (или значительной его частью), становится доступным правительству, чтобы постоянно следить за всеми нами. И, основываясь на этом мониторинге, правительство – и любая организация или компания, с которой оно сотрудничает – может затем использовать тот же инструмент для подавления, замалчивания и прекращения любых высказываний, которые ему не нравятся.

Но это не все. Используя тот же инструмент, правительство и его государственно-частные, «неправительственные» партнеры (например, Всемирная организация здравоохранения или «Монсанто») могут также прекратить любую деятельность, связанную с Интернетом. Банковское дело, покупка, продажа, обучение, обучение, развлечение, общение друг с другом – если контролируемому правительством ИИ не нравится то, что вы (или ваши дети!) говорите в твиттере или электронном письме, он может отключить все это для ты.

Да, мы видели это в очень локальном и политизированном масштабе, например, канадские дальнобойщики.

Но если мы думали, что такого рода деятельность не может или не произойдет в национальном (или, что еще хуже, глобальном) масштабе, нам нужно проснуться прямо сейчас и осознать, что это происходит, и, возможно, это невозможно остановить.

Новые документы показывают, что финансируемый государством искусственный интеллект предназначен для онлайн-цензуры

Специальный подкомитет Палаты представителей США по вооружению федерального правительства была создана в январе 2023 года «для расследования вопросов, связанных со сбором, анализом, распространением и использованием информации о гражданах США органами исполнительной власти, в том числе на предмет того, являются ли такие усилия незаконными, неконституционными или иным образом неэтичными».

К сожалению, работа комитета рассматривается, даже его собственными членами, как в основном политическая: законодатели-консерваторы расследуют то, что, по их мнению, является замалчиванием консервативных голосов со стороны либерально настроенных правительственных учреждений.

Тем не менее, в ходе своих расследований этот комитет обнаружил несколько удивительных документов, связанных с попытками правительства подвергать цензуре высказывания американских граждан.

Эти документы имеют решающие и устрашающие последствия для всего общества.

В промежуточном отчете Подкомитета от 5 февраля 2024 г.Документы показывают, что академические и некоммерческие группы предлагают правительственному агентству план использования «услуг дезинформации» искусственного интеллекта для цензуры контента на интернет-платформах.

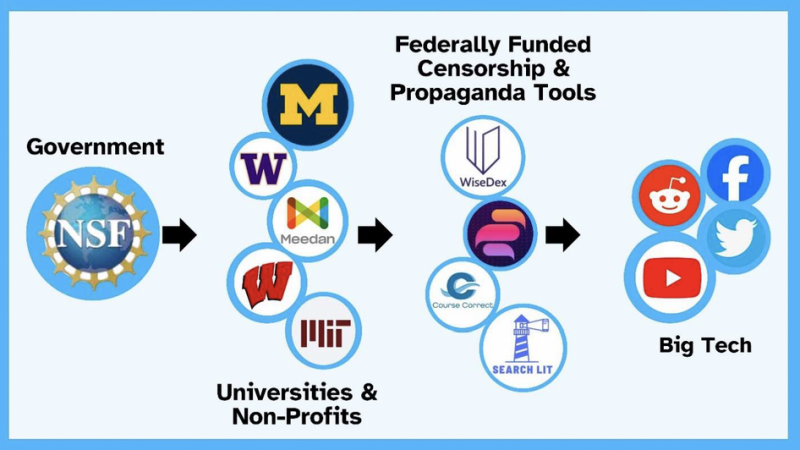

В частности, Мичиганский университет объясняет Национальному научному фонду (NSF), что инструменты на основе искусственного интеллекта, финансируемые NSF, могут использоваться, чтобы помочь платформам социальных сетей осуществлять цензурную деятельность без необходимости фактического принятия решений о том, что должно подвергаться цензуре.

Вот как эта связь визуализируется в отчете Подкомитета:

Вот конкретная цитата, представленная в отчете Подкомитета. Это взято из «заметок докладчика о первом представлении Мичиганского университета Национальному научному фонду (NSF) о его финансируемом NSF инструменте WiseDex на базе искусственного интеллекта». Записи находятся в архиве комитета.

Наша служба дезинформации помогает политикам на платформах, которые хотят… переложить ответственность за сложные суждения на кого-то за пределами компании… путем экстернализации трудной ответственности за цензуру.

Это экстраординарное заявление на многих уровнях:

- Он явно приравнивает «службу дезинформации» к цензуре.

Это важнейшее уравнение, поскольку правительства во всем мире делают вид, что борются с вредной дезинформацией, хотя на самом деле это так. принятие законопроектов о массовой цензуре, ВЭФ заявил «дезинформация и дезинформация» — это «самые серьезные глобальные риски» в ближайшие два года, что, по-видимому, означает, что их самые большие усилия будут направлены на цензуру.

Когда государственный подрядчик прямо заявляет, что продает «услугу дезинформации», которая помогает онлайн-платформам «экстернализировать цензуру», эти два термина признаются взаимозаменяемыми.

- Он называет цензуру «ответственностью».

Другими словами, предполагается, что часть того, чем должны заниматься платформы, — это цензура. Не защита детей от сексуальных хищников или невинных граждан от дезинформации – просто чистая цензура.

- В нем говорится, что роль ИИ заключается в «экстернализации» ответственности за цензуру.

Технологические платформы не хотят принимать решения о цензуре. Правительство хочет принимать эти решения, но не хочет, чтобы его воспринимали как цензуру. Инструменты ИИ позволяют платформам «экстернализировать» решения о цензуре, а правительству — скрывать свою цензурную деятельность.

Все это должно положить конец иллюзии о том, что то, что правительства всего мира называют «противодействием дезинформации и разжиганию ненависти», не является прямой цензурой.

Что произойдет, когда цензура ИИ будет полностью реализована?

Зная, что правительство уже платит за инструменты цензуры ИИ, нам нужно задуматься о том, что это влечет за собой.

Никаких ограничений по численности персонала: Как отмечается в отчете Подкомитета, ограничения государственной онлайн-цензуры до сих пор ограничивались большим количеством людей, которые должны были просматривать бесконечные файлы и принимать решения о цензуре. При использовании ИИ практически не требуется участие людей, а объем данных, которые можно отслеживать, может быть таким же огромным, как и все, что кто-либо говорит на конкретной платформе. Такое количество данных непостижимо для отдельного человеческого мозга.

Никто не несет ответственности: Один из самых пугающих аспектов цензуры ИИ заключается в том, что когда это делает ИИ, нет человека или организации (будь то правительство, платформы или университет/некоммерческие организации), которые действительно несут ответственность за цензуру. Первоначально люди дают инструменту ИИ инструкции относительно того, какие категории или типы языка подлежат цензуре, но затем машина идет дальше и самостоятельно принимает решения в каждом конкретном случае.

Без права подачи жалоб: Как только ИИ получит набор инструкций по цензуре, он будет собирать миллионы точек онлайн-данных и применять цензурные меры. Если вы хотите оспорить действие цензуры ИИ, вам придется поговорить с машиной. Возможно, платформы будут нанимать людей для ответа на обращения. Но зачем им это делать, если у них есть ИИ, который может автоматизировать эти реакции?

Никакой защиты для молодых людей: Одно из утверждений государственных цензоров заключается в том, что нам необходимо защищать наших детей от вредной онлайн-информации, например от контента, который вызывает у них анорексию, побуждает их к самоубийству, превращает их в террористов ИГИЛ и так далее. Также от сексуальной эксплуатации. Это все серьезные вопросы, которые заслуживают внимания. Но они не так опасны для огромного числа молодых людей, как цензура ИИ.

Опасность, которую представляет цензура ИИ, касается всех молодых людей, которые проводят много времени в Интернете, поскольку это означает, что их онлайн-деятельность и язык могут отслеживаться и использоваться против них – возможно, не сейчас, но всякий раз, когда правительство решит преследовать определенный тип людей. языка или поведения. Это представляет собой гораздо большую опасность для гораздо большего числа детей, чем опасность, которую представляет какой-либо конкретный контент, поскольку он охватывает всю деятельность, которую они ведут в Интернете, затрагивая практически все аспекты их жизни.

Вот пример, иллюстрирующий эту опасность: допустим, ваш подросток играет во множество интерактивных видеоигр онлайн. Допустим, ему нравятся игры, разработанные китайскими компаниями. Возможно, он также наблюдает, как другие играют в эти игры, и участвует в чатах и дискуссионных группах об этих играх, в которых также участвует множество граждан Китая.

В следующем месяце или в следующем году правительство может решить, что любой, кто активно занимается видеоиграми китайской разработки, представляет опасность для демократии. Это может привести к закрытию учетных записей вашего сына в социальных сетях или лишению его доступа к финансовым инструментам, таким как кредиты на обучение. Это также может включать в себя пометку его на сайтах по трудоустройству или знакомств как опасного или нежелательного. Это может означать, что ему отказывают в паспорте или помещают в список наблюдения.

Жизнь вашего подростка стала намного сложнее. Гораздо сложнее, чем если бы он увидел видео о вербовке ИГИЛ или пост в TikTok, прославляющий самоубийство. И это произойдет в гораздо большем масштабе, чем сексуальная эксплуатация, которую используют цензоры как троянский конь для нормализации идеи правительственной онлайн-цензуры.

Монетизируемые цензурные сервисы: Инструмент искусственного интеллекта, принадлежащий правительству, теоретически может использоваться неправительственной организацией с разрешения правительства и с благословения платформ, которые хотят «экстернализировать» «ответственность» за цензуру. Таким образом, хотя правительство может использовать ИИ для мониторинга и подавления, скажем, антивоенных настроений, компания может использовать его для мониторинга и подавления, скажем, настроений против фастфуда. Правительство могло бы заработать много денег, продавая услуги инструментов искусственного интеллекта третьим лицам. Платформы также могут попросить о сокращении. Таким образом, инструменты цензуры ИИ потенциально могут принести пользу правительству, технологическим платформам и частным корпорациям. Стимулы настолько мощные, что почти невозможно представить, что ими не воспользуются.

Можем ли мы изменить курс?

Я не знаю, сколько государственных учреждений и сколько платформ используют инструменты цензуры ИИ. Я не знаю, насколько быстро они смогут масштабироваться.

Я не знаю, какими инструментами мы располагаем – кроме повышения осведомленности и попыток лоббировать политиков и подавать иски, чтобы предотвратить государственную цензуру и регулировать использование инструментов ИИ в Интернете.

Если у кого-то есть другие идеи, сейчас самое время их реализовать.

Опубликовано под Creative Commons Attribution 4.0 Международная лицензия

Для перепечатки установите каноническую ссылку на оригинал. Институт Браунстоуна Статья и Автор.